NVIDIA – Kursreaktion? "Ausdruck von Ahnungslosigkeit", Research Scientist bei Google DeepMind. Nvidia-Story wegen Google TPUs vorbei?

- Lesezeichen für Artikel anlegen

- Artikel Url in die Zwischenablage kopieren

- Artikel per Mail weiterleiten

- Artikel auf X teilen

- Artikel auf WhatsApp teilen

- Ausdrucken oder als PDF speichern

Erwähnte Instrumente

- VerkaufenKaufen

Schnell. Sicher. Direkt.Trading über stock3 war noch nie so einfach.

Mehr erfahren Nein, danke

- NVIDIA Corp. - WKN: 918422 - ISIN: US67066G1040 - Kurs: 180,260 $ (Nasdaq)

Die Kurse der großen US-Chipwerte reagierten deutlich auf Medienberichte über eine mögliche strategische Zusammenarbeit zwischen Meta und Alphabet: NVIDIA verlor im Handel zeitweise 6 %, AMD mehr als 8 %, während Alphabet weiter zulegte. Der Markt preist offenbar die Sorge ein, Google könne mit seinen Tensor Processing Units (TPUs) einen wesentlichen Teil der Nachfrage nach NVIDIA- und AMD-Beschleunigern verdrängen. Aber nicht so schnell! Lasst eure Meinung nicht von der Kursreaktion bestimmen! Die Börse ist wie zu Deepseek Zeiten IRRATIONAL!

Fortsetzung Teil 2

Die Diskussionen um NVIDIA brechen nicht ab und haben in den vergangenen Wochen an Schärfe gewonnen. Auf der einen Seite steht die weiterhin außergewöhnlich starke Nachfrage nach KI-GPUs, die den Konzern zum zentralen Ausrüster des globalen AI-Investitionszyklus macht. Auf der anderen Seite häufen sich kritische Stimmen, die operative Kennzahlen, Finanzierungsstrukturen und die zunehmende TPU-Dynamik rund um Google in Frage stellen.

Ein NVIDIA-Memo, das gegenüber Analysten kursierte, liefert nun detaillierte Gegenargumente und ordnet viele der Vorwürfe ein. Parallel gewinnt Googles Strategie, seine TPUs breiter zu monetarisieren, erstmals Konturen. Zuvor waren diese nur für den Eigengebrauch vorgesehen. Bestätigt ist hier aber noch nichts offiziell.

In diesem Artikel gibts die Zusammenfassung der letzten Entwicklungen und deren Bedeutung.

1. Die Vorwürfe: Bilanzkennzahlen und angebliche Unregelmäßigkeiten

Auslöser der jüngsten Debatte sind mehrere Thesen, die teils in sozialen Medien verbreitet wurden, unter anderem von Investor Michael Burry. Die Kritik umfasst vier Bereiche:

1.1 Share Buybacks und SBC-Effekte

Burry hatte den Vorwurf erhoben, NVIDIA habe seit 2018 faktisch 112,5 Mrd. USD für den Rückkauf eigener Aktien aufgewendet, wenn man RSU-Steuern einrechnet. NVIDIA widerspricht: Tatsächlich belaufe sich das Volumen auf 91 Mrd. USD seit 2018. Die Einordnung der RSU-Steuern als Buyback-Kosten sei falsch. Zudem sei der Rückkaufpreis im historischen Vergleich unter dem fairen Wert gelegen und habe den Gewinn pro Aktie um rund 5 % erhöht.

1.2 Forderungslaufzeiten (DSO)

Kritiker sehen in der gestiegenen DSO-Kennzahl von 53 Tagen ein Zeichen dafür, dass Kunden Rechnungen nicht begleichen. NVIDIA hält dem entgegen, dass der langfristige Durchschnitt bei 52 Tagen liegt und die Q3-DSO gegenüber dem Vorquartal sogar gefallen ist. Modularisierte Lieferketten und längere Zahlungsziele großer Cloudanbieter erklären die Zyklik. Hinweise auf Zahlungsausfälle gebe es keine. Mehr Details im Teil 1.

1.3 Lagerbestände und angeblich schwache Nachfrage

Das Inventar wuchs zuletzt um 32 %. Für Kritiker ein Indiz für abkühlende Nachfrage. NVIDIA verweist auf eine klare Ursache: den Produktionshochlauf der Blackwell-Plattform. Der Bestand in "Work in Process" stieg um 98 %; typisch für eine neue GPU-Generation mit langen Fertigungszyklen und hohem Integrationsaufwand. Es geht hier nicht um einen Chip, sondern tonnenschwere Systeme. Auch hierzu mehr in Teil 1.

Die Entwicklung deckt sich zudem mit Schätzungen zu TSMCs CoWoS-Kapazitäten, die im gleichen Zeitraum um 25 bis 30 % ausgeweitet wurden.

1.4 Historische Vergleiche zu Enron, WorldCom und Lucent

Ein besonders drastischer Vorwurf lautet, die Situation erinnere an frühere Bilanzskandale. NVIDIA weist dies vollständig zurück: Das Unternehmen nutze keine Special Purpose Vehicles, es gebe keine Hinweise auf vendor financing, und die Kapitalisierungspraxis entspreche Industriestandards. Die Vergleiche seien sachlich nicht belastbar und entbehrten jeder quantitativen Grundlage.

Du willst auch künftig alle Trades & Analysen von Rocco & Valentin live erleben?

Warum 50 EUR zahlen, wenn du 20 % sparen kannst?

Am 5. Januar 2026 starten wir mit dem großen Jahresausblick 2026 durch. Rocco Gräfe und Valentin Schelbert zeigen dir von 19:00 bis 20:30 Uhr die Indexrouten des Jahres und die spannendsten Aktien aus USA und DAX.

Der Einzelpreis für das Webinar liegt bei 49,99 Euro, aber hier ist der bessere Deal für dich: Das Webinar ist im Premium-Service AktienPuls360 bereits komplett enthalten! Wenn Du Dich jetzt für das Jahresabo entscheidest, bist du am 5. Januar "gratis" dabei und sicherst dir zusätzlich mit unserem Aktionscode 20 % Rabatt auf die erste Laufzeit.

👉 Dein Code: 26AP360 (Gültig für Neu- und Bestandskunden bis zum 09.01.2026)

Hol dir das Experten-Duo für Fundamentalanalyse & Charttechnik in dein Depot und starte perfekt vorbereitet ins Jahr!

👉 Jetzt 20 % sichern & Jahresausblick inklusive erhalten

2. Die wirtschaftliche Realität

NVIDIAs Abhängigkeit von Hyperscalern bleibt ein strukturelles Risiko, und der vielleicht wichtigste Punkt in dieser Debatte. Absolut! 👍

61 % des Umsatzes entfallen auf direkte Cloud-Kunden und Serverhersteller, die für Hyperscaler fertigen. Das macht NVIDIA anfällig gegenüber Investitionsentscheidungen weniger großer Abnehmer. Ein zukünftiger Investitionszykluswechsel wäre ein Fundamentaldruckpunkt für Umsatz und Margen.

Andererseits ist genau diese Kundengruppe der Treiber der historisch beispiellosen AI-Capex-Welle. Google beschreibt in einem internen Briefing das Ziel, die Compute-Kapazität im eigenen Netzwerk alle sechs Monate zu verdoppeln. Ein Vorhaben, das nur über massives Infrastruktur-Capex erreichbar ist.

Entscheidend wird daher nicht ein einzelnes Quartal sein, sondern die Frage, wie lange Hyperscaler bereit sind, den aktuellen Ausbautakt durchzuhalten. Aber auch da gibt es schon Lösungen am Horizont (Teil 1)

3. Googles TPU-Offensive

Parallel zu den Vorwürfen beschäftigt Anleger die Frage, wie stark Googles Tensor Processing Units (TPUs) den Markt für KI-Beschleuniger verändern könnten. Insbesondere solltet ihr wissen, dass die Nutzung der TPUs keineswegs neu ist und für mich eher gezielte Schüsse gegenüber NVIDIA darstellen, um ein Narrativ zu schüren und gewisse Parteien mit Eigeninteressen zu beglücken. Aber das ist nur eine Theorie meinerseits.

3.1 Google präsentiert TPU-Erfolge offensiver

Erstmals positioniert Google seine TPUs nicht nur als internes Werkzeug, sondern als potenzielles Exportprodukt für Hyperscaler. Kern der jüngsten Spekulationen ist ein Bericht, wonach Meta ab 2027 Milliardenbeträge investieren will, um Googles TPUs in eigenen Rechenzentren zu nutzen. Kurzfristig, möglicherweise bereits im kommenden Jahr, soll Meta zunächst TPU-Kapazitäten über die Google-Cloud-Infrastruktur anmieten. Hier gab es schon Meldungen von einem 10 Mrd. USD Deal. Damit würde Google sein bisheriges Modell ausweiten: TPUs waren historisch primär ein proprietärer Beschleuniger innerhalb von Google Cloud. Künftig stünde neben dem "as-a-service"-Modell eine On-Premise-Option für Großkunden im Raum. Wichtig ist dabei: Aktuell handelt es sich um Verhandlungen und Testszenarien, nicht um final bestätigte, langfristig fixierte Lieferverträge.

3.2 Ein möglicher Paradigmenwechsel

Sollte Meta TPUs in größerem Umfang integrieren, hätte dies mehrere Implikationen:

- Für Google: Einstieg in ein Geschäft, das bislang exklusiv intern blieb. Erstmals würde Google als Chip-Lieferant für andere Hyperscaler auftreten. Eine interne Google-Schätzung, wonach TPUs potenziell "bis zu 10 %" von NVIDIAs Jahresumsatz adressieren könnten, ist aus Branchenperspektive eher als grobe Größenordnung denn als kurzfristige Prognose zu verstehen. Zumal der Research Scientist bei Google DeepMind eine klare Meinung hat (Fazit).

- Für Broadcom: Der langjährige TPU-Fertigungspartner könnte ein signifikantes Auftragsplus erhalten. HSBC schätzt die TPU-Shipments 2026 auf mehr als 3 Mio. Einheiten. Dafür würde aber Meta seinen Auftrag bei Broadcom potenziell leicht reduzieren.

- Für NVIDIA: Das Umsatzpotenzial einzelner Hyperscaler könnte sich diversifizieren, ohne dass der Gesamtmarkt schrumpft. Der Kuchen wird größer, nicht kleiner. Die Börse denkt gerade sehr in schwarz-weiß/ alles-oder-nichts.

- Für Meta: Hier ist der Einsatzbereich der Chips entscheidend. Meta weist zwei große Compute-Blöcke auf. Einmal für die Kernplattform. Dazu zählen Anzeigenauktionen, Ranking-Algorithmen, Empfehlungssysteme und die Generierung von Werbemitteln (Bild-, Text- und Video-Creation). In diesen Systemen laufen überwiegend Inferenz-Workloads, teils mit hohen Latenzanforderungen, aber relativ standardisierten Rechenmustern. Und dann das FAIR. Hier werden große Sprachmodelle trainiert und weiterentwickelt, inklusive komplexer Reasoning-Aufgaben, längerer Kontexte und experimenteller Architekturen. Diese Workloads sind deutlich breiter und heterogener. TPUs sind eher in spezifischen, gut standardisierbaren Workloads wie Recommendation, klassischer Inferenz oder generischer Werbemittel-Erzeugung gut einsetzbar. Hochkomplexe Trainings- und Multi-Stage-Reasoning-Workloads dürften weiterhin überwiegend auf flexiblen GPU-Clustern laufen. Der Markt reagiert dennoch so, als würden TPUs die GPU-Nachfrage vollständig substituieren; diese Interpretation erscheint zu stark vereinfachend.

Aber ... 👇

3.3 NVIDIA GPU vs Alphabets TPU

Technisch bleibt NVIDIA in der Spitzenklasse vorn. Ein Vergleich in Morgan-Stanley-Unterlagen zeigt eine klare Differenz zugunsten der GB200- und GB300-Klasse bei Leistung und Dichte (Grafik aus Teil 1)

- Kundenspezifische ASICs (TPUs, etc) sind auf klar definierte Rechenmuster optimiert, erzielen hohe Effizienz und eignen sich insbesondere für skalierbare, wiederkehrende Inferenzaufgaben (Empfehlungen, Klassifikationen, Standard-Chatbots).

- General Purpose GPUs (Nvidia) bieten hohe Flexibilität bei unterschiedlichen Modellen, Frameworks und Workloads. Von Frontier-Training über komplexe Inferenz mit Test-Time-Compute bis hin zu Agenten-Workflows mit vielen Zwischenschritten.

Meta bezeichnete sein Werbegeschäft selbst als "compute starved": Trotz bereits aufgebauter Infrastruktur fehlt zusätzliche Rechenleistung, um weitere Umsatzpotenziale zu heben. Parallel gilt NVIDIA bis weit in die kommenden Jahre hinein als ausgelastet; Branchenberichte verweisen auf knappe Verfügbarkeiten bis etwa 2026. Und TSMC ebenso.

Vor diesem Hintergrund wirkt ein hybrider Ansatz rational: Einfache oder klar strukturierte Workloads werden auf spezialisierte, potenziell günstigere Beschleuniger ausgelagert, um teure und knappe GPU-Kapazität für komplexe Modelle und neue Produkte freizuhalten. Das spricht für eine Verschiebung im Workload-Mix, nicht für eine flächendeckende Substitution.

TPUs punkten dagegen in spezifischen Workloads, insbesondere Inferenz im Bereich Ranking und Recommendation, ein Kerngebiet von Meta. Die Systeme TPU vs Nvidia konkurrieren daher weniger direkt, als es die Schlagzeilen suggerieren.

Wenn Meta eine stärkere TPU-Nutzung in standardisierten Bereichen anstrebt, könnte dies eher die Position des zweiten GPU-Anbieters aka AMD belasten als jene des dominierenden Marktführers NVIDIA.

4. NVIDIA reagiert

Die Diskussion um NVIDIAs ungewohnt häufigen öffentliche Statements, ob zu Michael Burry, DeepSeek oder nun den TPU-Schlagzeilen, wirken nur auf den ersten Blick wie ein Zeichen von Nervosität. Tatsächlich passt sie ziemlich gut zu dem, was Jensen Huang intern kommuniziert: Er sieht NVIDIA als das Fundament der aktuellen KI-Ökonomie, und genau deshalb reagiert er, wenn zentrale Narrative infrage gestellt werden. Seine Memos nach den letzten Quartalszahlen zeigten deutlich, dass er das Marktbild sehr genau verfolgt und versteht, wie sensibel die große KI-Story gegenüber Zweifeln an NVIDIAs Zahlen, Nachfrage oder strategischer Position ist.

Es wäre ungleich merkwürdiger, wenn NVIDIA zu zentralen Vorwürfen schweigen würde, die implizieren, man würde Nachfrage künstlich aufblasen oder bilanziell tricksen. Ein solcher Vorwurf würde nicht nur NVIDIA treffen, sondern die gesamte KI-Infrastruktur am Markt erschüttern. Wenn NVIDIA tatsächlich die Bücher frisieren oder eine künstliche Nachfragekulisse aufbauen würde, hätten sämtliche Sell-Side-Analysten, Branchenexperten und Großkunden kollektiv daneben gelegen. Die gesamte KI-Investitionswelle wäre ein Luftschloss. Und genau das ist extrem unwahrscheinlich.

Jensens Reaktionen wirken deshalb weniger wie Verteidigungsreflexe, sondern eher wie Klarstellungen eines CEOs, der verhindern will, dass vereinzelte Fehlinterpretationen die strategische Erzählung seiner Firma kaputtmachen. Gerade in einer Marktphase, in der jedes Signal über Chips, TPUs oder Nachfrage sofort Milliarden bewegt, ist es rational, dass NVIDIA aktiv kommuniziert, statt Gerüchte einfach laufen zu lassen.

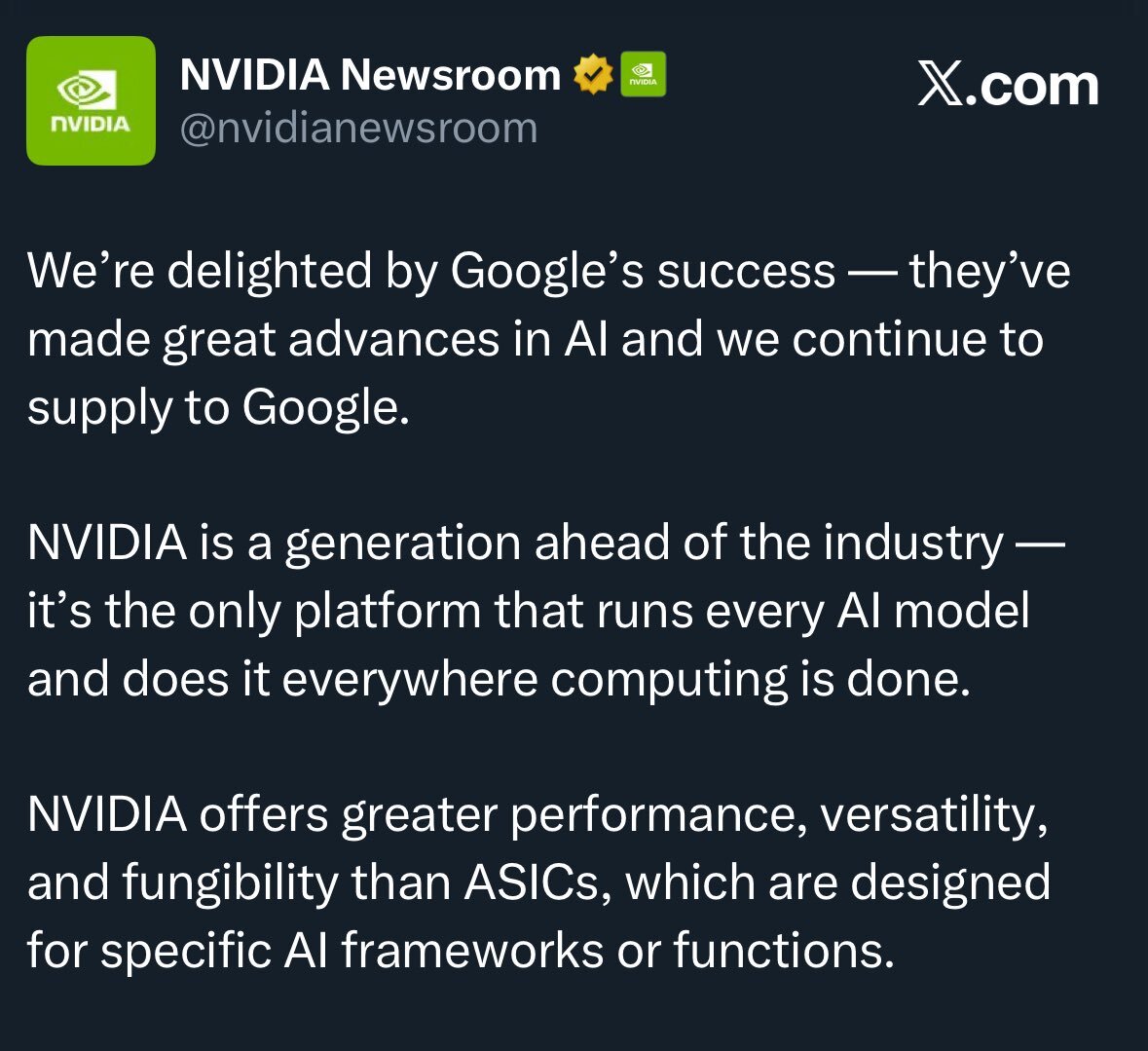

In mehreren Stellungnahmen unterstreicht NVIDIA, man begrüße Googles Fortschritte und sei weiterhin Lieferant für Google Cloud. Gleichzeitig betont NVIDIA seine "eine Generation Vorsprung" umfassende Plattformstrategie, die sämtliche KI-Modelle und Deployment-Formen unterstützt. Im Gegensatz zu ASIC-basierten Systemen, deren Einsatzbereich enger ist.

Das ist auch das Argument, welches ich immer wieder bringe und das vor allem solange relevant ist, solange Energie und Infrastruktur ein rares Gut sind.

5. Hast Du Dir schon diese Fragen gestellt? Vorprodukte & Wettbewerbssituation zwischen Meta & Alphabet

Gleichzeitig bestehen in der Lieferkette strukturelle Engpässe, insbesondere bei High Bandwidth Memory und Advanced Packaging. Hersteller wie SK Hynix und Micron berichten seit Längerem über sehr hohe Auslastungsgrade bei HBM. Zusätzliche Nachfrage nach TPUs vergrößert den Gesamtmarkt nicht beliebig, sondern konkurriert um dieselben knappen Vorprodukte! Selbst wenn ein einzelner Hyperscaler temporär weniger NVIDIA-GPUs abnimmt, werden andere Anbieter diese Kapazität mit hoher Wahrscheinlichkeit absorbieren. Ein breiter Preisverfall aufgrund eines Meta-Google-Deals erscheint unter diesen Bedingungen wenig plausibel.

Für Meta ist die Wahl des Chippartners nicht nur eine Frage von Leistung und Preis, sondern auch strategischer Abhängigkeiten. Alphabet konkurriert im Kerngeschäft direkt mit Meta (Digitale Werbung) und betreibt ebenfalls umfangreiche KI-Labs. In einem Szenario, in dem künftige Gemini-Generationen oder andere Alphabet-KI-Produkte zusätzliche interne TPU-Kapazität erfordern, könnte Google versucht sein, eigene Workloads zu priorisieren. Meta würde damit einen Teil seiner zentralen Infrastruktur auf eine Plattform auslagern, die zugleich Wettbewerber und Lieferant ist.

NVIDIA besitzt keine großen Endkundenplattformen wie Suchmaschinen oder Social Networks und agiert als vergleichsweise neutraler "Arms Dealer" der Branche. Für Hyperscaler ist diese Neutralität ein Wert an sich, da Interessenkonflikte entlang der Wertschöpfungskette begrenzt bleiben.

Hinzu kommt, dass Inferenz durch Techniken wie Test-Time-Compute (Thinking, Chain-of-Thought-Modelle) anspruchsvoller wird. Modelle führen mehr Rechenschritte pro Anfrage aus, um Qualität und Robustheit der Antworten zu erhöhen. Das verschiebt einen Teil des Rechenbedarfs aus dem einmaligen Training in die produktive Nutzung. NVIDIA adressiert diesen Trend mit einem breiten Systemansatz.

CUDA als Programmierungsumgebung mit zahlreichen Bibliotheken, GPUs für Training und Inferenz, CPUs (Grace & Vera) und DPUs (BlueField), Netzwerkkomponenten (etwa Spectrum X, NVLink, Switch-Systeme), sowie die Integration kundenspezifischer Beschleuniger in eine einheitliche Plattform per NVLink Fusion. Diese vertikale Integration erhöht die Bindungskraft des Ökosystems und erschwert es Wettbewerbern, nur mit einem einzelnen Chipangebot dieselbe Systemtiefe zu erreichen. Parallel arbeiten zahlreiche Konzerne an eigenen Beschleunigern: Amazon (Trainium), Microsoft (Maia), Meta (eigene KI-ASICs), Huawei und andere.

Du willst auch künftig alle Trades & Analysen von Rocco & Valentin live erleben?

Warum 50 EUR zahlen, wenn du 20 % sparen kannst?

Am 5. Januar 2026 starten wir mit dem großen Jahresausblick 2026 durch. Rocco Gräfe und Valentin Schelbert zeigen dir von 19:00 bis 20:30 Uhr die Indexrouten des Jahres und die spannendsten Aktien aus USA und DAX.

Der Einzelpreis für das Webinar liegt bei 49,99 Euro, aber hier ist der bessere Deal für dich: Das Webinar ist im Premium-Service AktienPuls360 bereits komplett enthalten! Wenn du dich jetzt für das Jahresabo entscheidest, bist du am 5. Januar "gratis" dabei und sicherst dir zusätzlich mit unserem Aktionscode 20 % Rabatt auf die erste Laufzeit.

👉 Dein Code: 26AP360 (Gültig für Neu- und Bestandskunden bis zum 09.01.2026)

Hol dir das Experten-Duo für Fundamentalanalyse & Charttechnik in dein Depot und starte perfekt vorbereitet ins Jahr!

👉 Jetzt 20 % sichern & Jahresausblick inklusive erhalten

Fazit

Während NVIDIA, AMD und Oracle nach den TPU-Schlagzeilen deutlich unter Druck geraten sind, bezeichnet Amir Yazdan, Research Scientist bei Google DeepMind und selbst Mitentwickler der TPU-Architektur, die Reaktion als Ausdruck von Ahnungslosigkeit. Für ihn zeigt der Sell-off vor allem, wie wenig der Markt die tatsächliche Hardware- und Nachfrage-Mechanik versteht.

Wenn jemand TPU-basierte Workloads realistisch mit GPU-Workloads vergleichen kann, dann jemand in dieser Rolle. Und genau er sieht keine Bedrohung für die GPU-Nachfrage, im Gegenteil. Die breite KI-Nachfrage bleibt enorm, Compute bleibt knapp, und TPUs sind keine Ersatzlösung für den Gesamtmarkt, sondern eine Ergänzung.

Die Debatte zeigt zwei Ebenen. Zum einen die operative Realität. Denn die im Umlauf befindlichen Kritikpunkte zu Bilanzkennzahlen sind komplett nicht haltbar und Stuss. Forderungsdauer, Inventarstruktur und Buyback-Politik lassen sich plausibel durch Branchenmechaniken erklären. Zum anderen das strukturelle Risiko. Der wesentliche Faktor bleibt der Investitionszyklus der Hyperscaler. Hier liegt das echte makrooperative Risiko für NVIDIA. Sollte sich der Ausbautakt in zwölf bis 24 Monaten normalisieren, wäre eine zyklische Abkühlung unausweichlich.

Die strategische Relevanz liegt weniger in Einzelkennzahlen als in der Entwicklung des globalen AI-Capex-Zyklus. Dieser bestimmt die mittelfristige Ertragskraft weitaus stärker als die Frage, ob Meta ab 2026 einige Workloads auf TPUs verlagert. Solange Cloudanbieter ihre Infrastruktur im Halbjahresrhythmus ausbauen müssen, bleibt Nvidia ein zentraler Profiteur. Entscheidend ist daher nicht, ob Googles TPUs wachsen, sondern, wie lange die Hyperscaler bereit sind, KI-Investitionen auf dem aktuellen Niveau fortzuführen. Der Kuchen wird größer und NVIDIA immer günstiger. Setzt Euch nochmal mit den Earnings auseinander und den Themen Physical AI, Omniverse, Cosmos sowie in dem Zusammenhang KI & Digitale Zwillinge.

Die starke Kursreaktion von NVIDIA und AMD auf die Diskussion um eine erweiterte Kooperation zwischen Meta und Google spiegelt vor allem eines wider: die Nervosität eines Marktes. Ökonomisch spricht vieles dafür, den möglichen TPU-Einsatz bei Meta als Risikostreuung und Lastenverschiebung zu interpretieren ist. Nicht als unmittelbare Disruption des GPU-Geschäfts. Zumal nichts offiziell ist.

Die strukturelle Nachfrage nach GPUs bleibt durch wachsende KI-Workloads hoch, während HBM und Packaging Kapazitäten die limitierenden Ressourcen sind. Ein Meta-Google-Deal könnte Preisdruck vor allem auf den "Second Source"-Anbieter AMD erhöhen, ohne die Marktstellung von NVIDIA in absehbarer Zeit grundlegend zu untergraben. Die strategische Abhängigkeit Metas von einem direkten Wettbewerber spricht dafür, dass Meta TPUs eher als Ergänzung denn als vollständigen Ersatz seiner GPU-Flotten einsetzen dürfte. NVIDIAs System- und Ökosystemvorsprung bleibt ein zentrales Asset, insbesondere mit Blick auf komplexer werdende Inferenz und integrierte Rechenzentrumsarchitekturen.

Viel Erfolg wünscht euch Valentin

Passende Produkte

| WKN | Long/Short | KO | Hebel | Laufzeit | Bid | Ask |

|---|

Ist Valentin cleverer als der Markt? Ich denke, dass alles in den Kursen enthalten ist...

Absolute Klasse.Danke, Valentin

Du bist ein Großer.

ich sage ja dass ist dein Wissens Knowhow. Du bist der Sehende unter den Blinden....

Klasse par excellence 👍 In der Tat ein sehr komplexes Thema, verständlich erklärt . Jetzt muß man es nur noch dem Markt erklären ...wie wenig der Markt die tatsächliche Hardware- und Nachfrage-Mechanik versteht.... Du solltest mal bei CNBC oder Bloomberg im TV auftreten! Die vielen oberflächlichen Artikel sonstwo am Markt zu Nvidia erinnern entfernt an Stammtisch-Hobbyschrauber🙄, die meinen, sie könnten bei einer Motorenentwicklung mitreden😉

Starke Analyse! Das was du hier als Free Content zur Verfügung stellst, können viele nicht mal gegen Bezahlung bieten.